内容摘要:

本报告介绍了军备控制的含义、实施阶段和实施方式,从合意性和可行性两个角度梳理了促成、阻碍达成军控的相关因素;根据合意性与可行性相互交织、共同作用的特点,分析了导致军控成败的原因,特别是新兴技术军控面临的特殊挑战;在前述理论分析的基础上,从人工智能技术作为通用技术、新兴技术和核查军控遵守情况三个方面,深刻分析了它给军备控制带来的挑战,并给出相应的解决建议。报告认为,人工智能技术自身的特点以及未来发展和应用的不确定性,给实施军控带来了多重困难,但是借鉴以往军控的成功经验,特别是利用该技术所依托的半导体产业链等,针对人工智能技术的军控在适当条件下也是现实可行的。

1 军备控制及其合意性与可行性

1.1军备控制

所谓军备控制,是指各国为控制某些武器的研究、开发、生产、部署或使用,武器特性,武器应用或武器运载系统等而签订的协议。

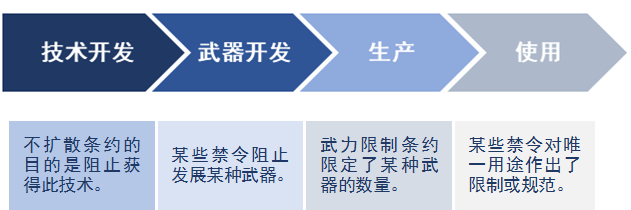

军备控制可以发生在武器开发和使用的各个阶段,且有不同重点和内容:禁止获得武器的底层技术;禁止开发、生产或储存某种武器;限制国家在和平时期可以拥有的某些武器数量;限制在战时以某些方式使用武器或完全禁止使用武器。

图1 武器开发和使用全寿命周期军备控制措施

国家间的军备控制是例外而非常规。它可以通过多种方式实施,主要包括:具有法律约束力的条约、长期以来由国家实践产生的国际惯例法、不具有法律约束力的文书,甚至是国家之间未明确声明但却导致相互制约的默契。一般来说,正式协议是国家之间达成明确限制内容的有效的协调机制;仅在极少数情况下,国家间通过默契形成制约。即使是成功的军备控制,大多数情况下也只存在于一定范围内。几乎不存在完全成功、没有任何违反情况的军控协议。

1.2军备控制的合意性

军备控制的合意性,是国家基于对武器的军事价值和恐怖程度的认知,综合计算权衡的结果。换而言之,它取决于国家为自身目的保留武器的愿望与限制对手使用武器的愿望之间的权衡。因此,合意性包含了激励或抑制各国试图采取某种形式控制的标准。

1.3军备控制的可行性

军备控制的可行性包含的是决定能否长期、成功实施军控的社会政治因素。具体包括以下因素:各国之间明确希望达到的制约程度、军控协议的可执行性、国家核实其他各方遵守协议情况的能力、达成协议所需的国家总数、军备控制的实现路径。

2 影响军备控制成败的原因

2.1影响军备控制成败的一般原因

军备控制的成败取决于其合意性和可行性;当二者都很高时,军控成功的可能性最大。合意性与可行性相互交织、共同作用,影响了军备控制的最终成败,具体体现在武器的军事价值(效力)、武器的恐怖程度、军控协议、对交互性的恐惧等。随着时间的推移,军备控制的合意性和可行性会发生变化。特别是随着技术的进步和发展,某些武器或能力会更有价值,或者会被污名化。此外,即使合意性和可行性都存在,军控也可能失败。

2.2新兴技术军控面临的特殊挑战

新兴技术的发展路径及其应对措施很难预测。所以对其管控实际建立在假设之上,而假设以后可能被证明是错误的,这就使军控的合意性和可行性复杂化。具体可能有以下情形:

1.一些国家可能倾向于先发制人地限制新技术或新武器,尤其在担心可能发生军备竞赛的情况下。

2.国家可能不愿放弃军事价值尚不完全清楚的能力。

3.在武器投入战场之前,各国可能无法理解其恐怖之处。

4.国家可能误判了技术发展路径,尤其是不太可能成功预测技术将如何发展的细节,从而导致军控失败。

3 人工智能技术给军控带来的挑战及解决办法

人工智能技术给军备控制带来了三个方面的挑战:其一,人工智能技术具有扩散性,其许多应用具有军民两用性质,因此难以确定管制焦点;其二,人工智能技术是一种新兴技术,其全部潜力尚未实现,这可能会阻碍对它进行管控的努力;其三,核查人工智能军控协议也是一项挑战,各国可能需要制定办法,以确保其他国家遵守协议,从而能够放心地限制自己的能力。

3.1作为通用技术给军控带来的挑战及解决办法

3.1.1挑战

人工智能技术是一种通用赋能技术,具有民用、军用双重用途,可广泛应用于很多领域。这两个特点分别给军控带来了不同挑战。

从扩散性特点看,一是难以形成有效的防扩散机制,实现对人工智能技术的“封锁”并减少其传播。二是行为体数量大幅增加,加大了协调工作难度。因为需要许多行为体遵守规则,人工智能技术的军控才可能有效。

从通用性特点看,具体表现为定义模糊(一项技术是否可以算作“人工智能”,可能有多种解释);应用领域广泛(人工智能的实践领域极其广泛);管控界线不清(军用、民用界限不清;在可接受和不可接受的应用之间,其界限也可能模糊不清,对此必须要有明确的协议)。

3.1.2解决办法

历史经验表明,对于人工智能这样的通用技术,禁止其所有的军事应用不切实际,但是可以达成对其特定军事应用的限制。所有问题的关键在于,需要确定特定军事应用的具体内容。可以考虑进行军控的情况包括:(1)用于被视为特别危险、造成不稳定或在其他方面有害的特定用途;(2)用于核稳定、自动武器、网络安全或其他值得额外考虑的特定应用;(3)针对被视为特别有问题的特定应用实例,制定严格的禁令或法规。

3.2作为新兴技术给军控带来的挑战及解决办法

对于新兴技术的军控既容易又困难:一方面,采取先发制人的办法禁止新兴技术,相对比较容易,因为相关国家希望牢牢掌控已成为其武力一部分的新式武器;另一方面,监管新兴技术更具挑战性,因为军队的成本效益权衡是未知的,某种武器的军事效力只有在使用时才能知道。

当前对人工智能技术进行军控的最大障碍,正是对其有效性的认识。但与其他新兴技术一样,目前尚不清楚人工智能在战争中的使用方式,更不清楚它可能带来的军事效力。各国军方都认为,人工智能是一种“改变游戏规则”的技术,人工智能系统具有超人的能力、精度、可靠性或效力,因此无人愿意去禁止人工智能技术的某些应用,同时也不会重视某些人工智能应用可能不稳定或存在危险的问题。甚至即使在某些情况下,特定应用被视为应加以管控,但如果它们已经被纳入国家军事力量或在战场上使用,也不可能成功实施军控。

3.3核查军控遵守情况面临的挑战及解决办法

核查对军控机制的遵守情况,对成功与否也至关重要。人工智能技术的复杂之处在于,人工智能系统所拥有的认知属性不容易在外部观察到。“智能”炸弹、导弹或汽车看起来与同类型的“愚蠢”系统差不多。自动驾驶汽车用来感知环境的传感器是可见的,但所使用的特定算法是不可见的。各国如果无法核实他国是否遵守协议,就无法维持相互制约。对此,有几种办法可供参考:

1.采用侵入性检查:允许第三方观察员进入设施和特定军事系统,以核实其软件是否符合人工智能军控机制。

2.严格限制人工智能赋能系统的可观察外部物理特征:各国选取希望从某系统(包括传感器、硬件、软件等)得到的认知特征,针对载具或弹药等的总体物理特征做出限制。

3.约束人工智能系统的可观察行为:对人工智能系统在特定条件下的运行方式做出限定。此办法的关注点不是人工智能系统的内部逻辑,而是其外在行为,因此为系统行为编程的具体算法无关紧要。该办法在监控人工智能系统的物理表现时最为有效,因为他国可以观察到系统的外在行为,如自主水面舰艇在靠近其他舰艇时如何行动,自动武器系统如何清晰发出武力升级信号,等等。

4.限制计算基础设施:对人工智能硬件中可观察或可管控的要素做出限制。芯片等硬件要素是人工智能系统有用于计算的物理基础设施,因此可以通过针对相关芯片的防扩散机制,实现对人工智能技术的军控。

文章来源|CNAS

编译|智能society

Last modified: 2022年 11月 7日